当日のセミナー動画

このセミナーのテキストのダウンロードはこちらから

データインポート とは

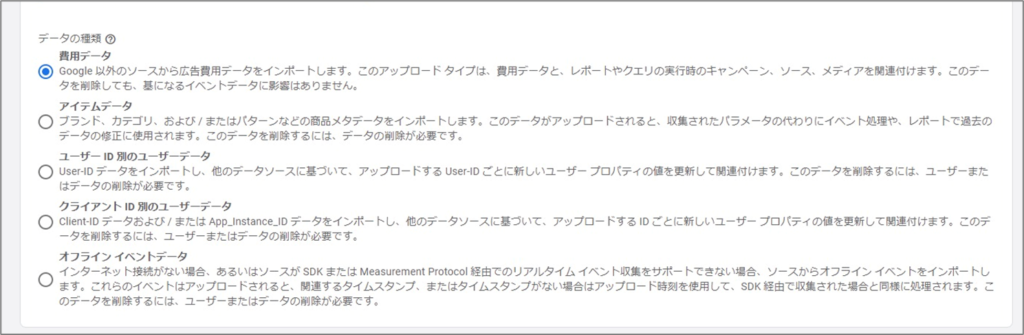

データインポート とは、外部ソースからデータをアップロードし、アナリティクスのデータと結合する機能です。データインポートには、下記の5種類があります。

「費用データ」

「アイテムデータ」

「ユーザー ID 別のユーザーデータ」

「クライアント ID 別のユーザーデータ」

「オフライン イベントデータ」

後半で、それぞれについて解説します。

公式ヘルプ:https://support.google.com/analytics/answer/10071301?hl=ja

データインポートを使用する理由

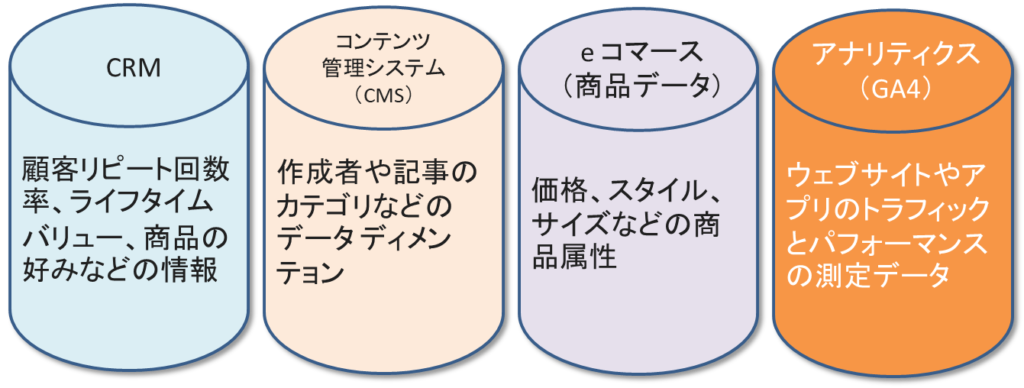

各種ビジネス用システムでは、それぞれ独自のデータが生成されます。

通常これらのデータはそれぞれサイロ化(連携されていない状態)されており、互いに情報のやりとりはありません。データ インポートは、定義したスケジュールでこういったデータをアナリティクスに集約して結合することができ、サイロ化の解消、新たなインサイトの発見、データの民主化に役立ちます。

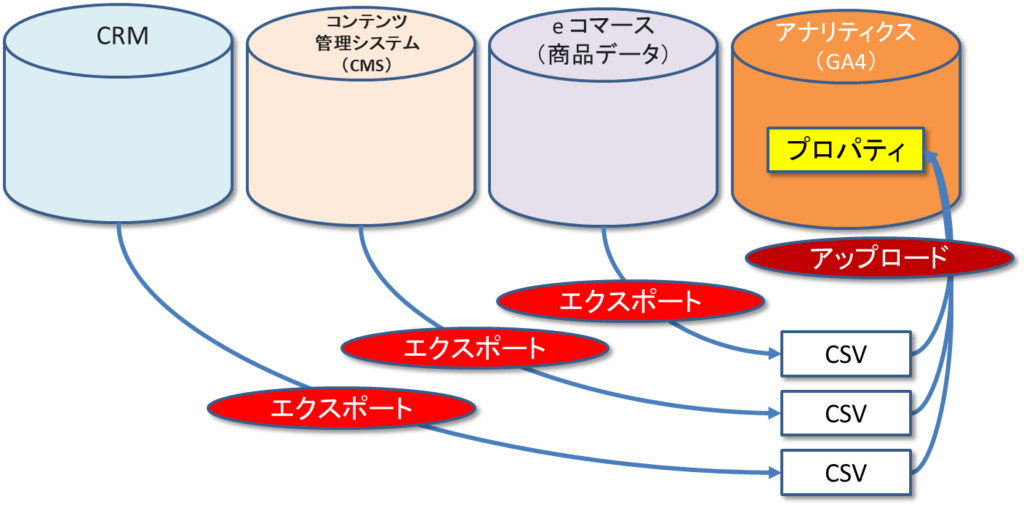

データ インポートの仕組み データのアップロード

外部のデータを格納した CSV ファイルを、GA4のプロパティにアップロードします。CRM や CMS といったオフラインのビジネスツールからこうした CSV ファイルをエクスポートして使用できるほか、少量のデータであればテキスト エディタやスプレッドシートでファイルを手動作成することも可能です。

アップロードしたオフライン データは、GA4が収集したイベントデータと結合されます。これによってレポート、比較、オーディエンスのデータが強化され、ユーザーのアクティビティをオンラインとオフラインの両面にわたって総合的に把握できます。

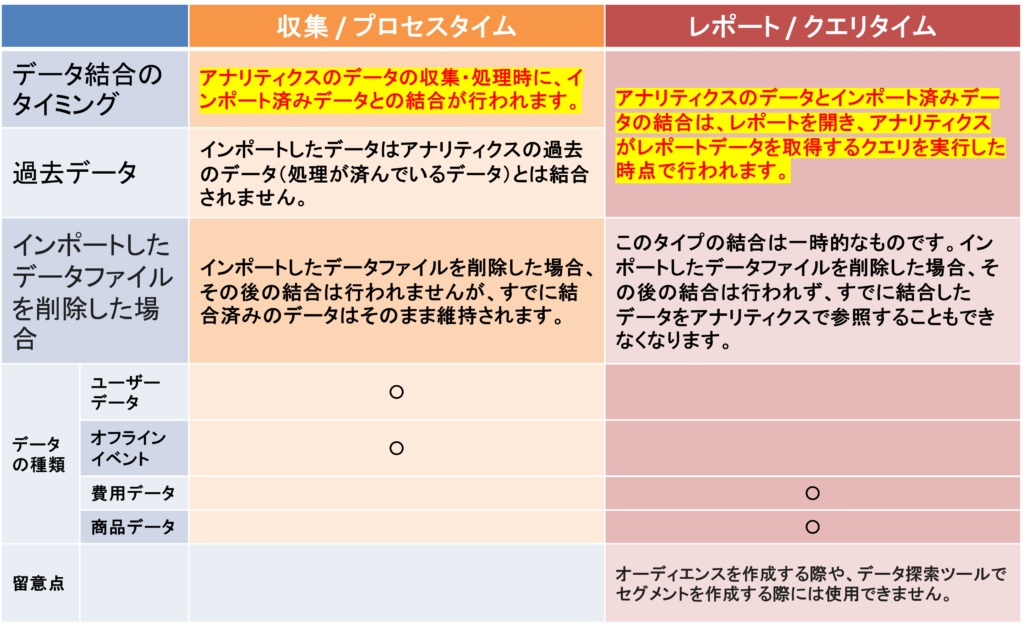

データ結合のタイミング

インポートしたデータの種類に応じて、次のいずれかの方法でデータの結合が行われます。

インポートできるメタデータの種類

メタデータ(本体であるデータに関する付帯情報が記載されたデータ)

インポートしたメタデータは、プロパティによって収集・処理済みのデータに追加されます。メタデータは通常、カスタム ディメンションまたは指標に格納されますが、収集済みのデフォルト情報を上書きした方が便利なケースもあります(カテゴリ構成を更新した商品カタログをインポートする場合など)。

インポートできるデータの種類は次の通りです。

| データの種類 | 説明 |

| 費用データ | サードパーティ(Google 以外)の広告ネットワークのクリック数、費用、表示回数データ |

| 商品データ | 商品のメタデータ(サイズ、色、スタイル、その他の商品関連ディメンションなど) |

| ユーザーデータ | リピート回数率や顧客のライフタイム バリューなど、セグメントやリマーケティング リストの作成に使用できるユーザー メタデータ |

| オフライン イベント | インターネット接続が利用できないソースや、リアルタイムでのイベント収集がサポートされていないソースのオフライン イベント |

データインポートの上限

| 保存容量の合計 | 10 GB |

| データソースのサイズ | 1 GB |

| 1 日あたりのアップロード量 | アップロード回数: 24 累積容量: 10 GB |

データをインポートする方法

データをインポートする際には、データソースを作成します。データソースとは、アップロードする CSV ファイルと、既存のアナリティクス フィールドから CSV のフィールドへのマッピングの組み合わせです。

公式ヘルプ:https://support.google.com/analytics/answer/10071301?hl=ja

※重複したキーを含むファイルはアップロードしないでください(例: user_id という名前の 2 つのフィールド)。

インポート プロセス

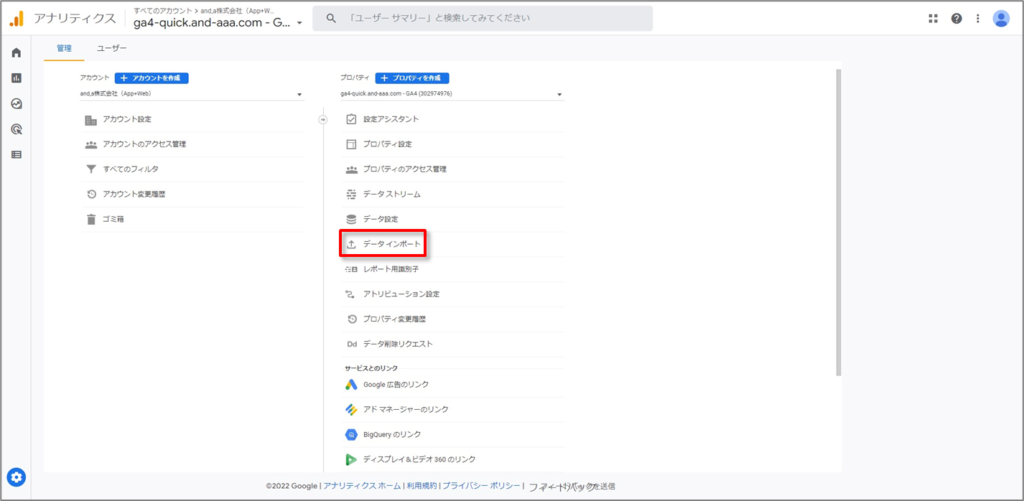

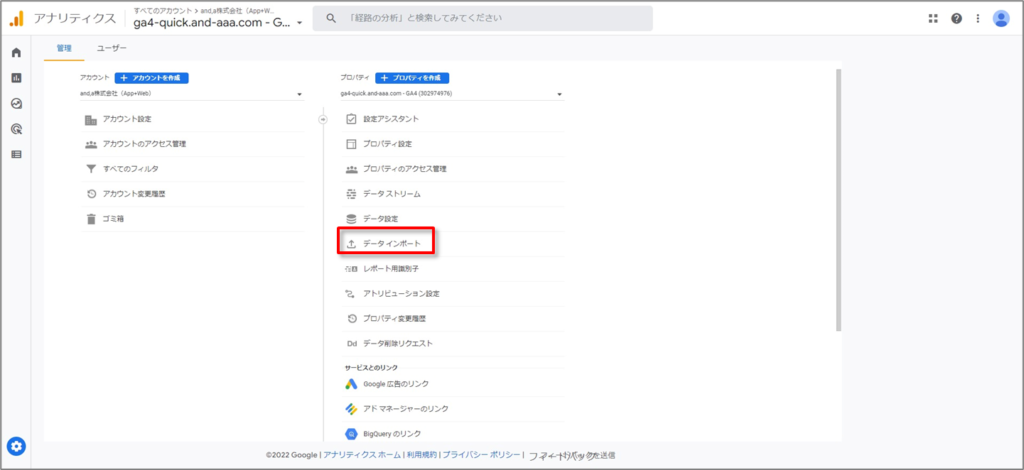

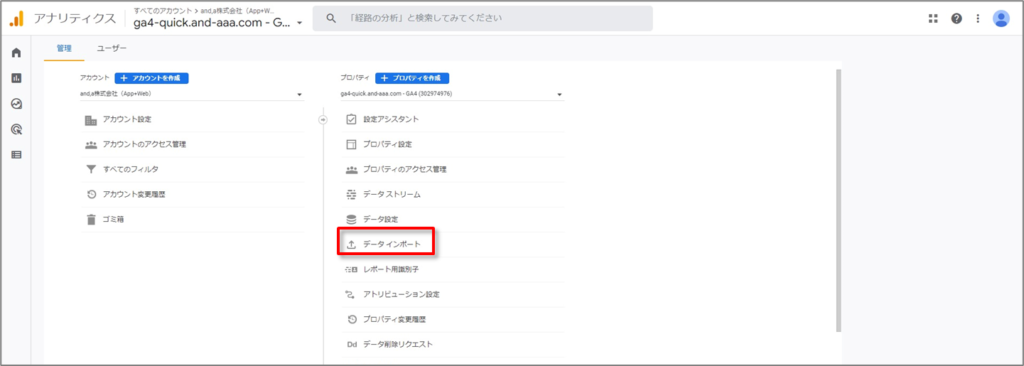

管理 > 「プロパティ」列 > データ インポート をクリック

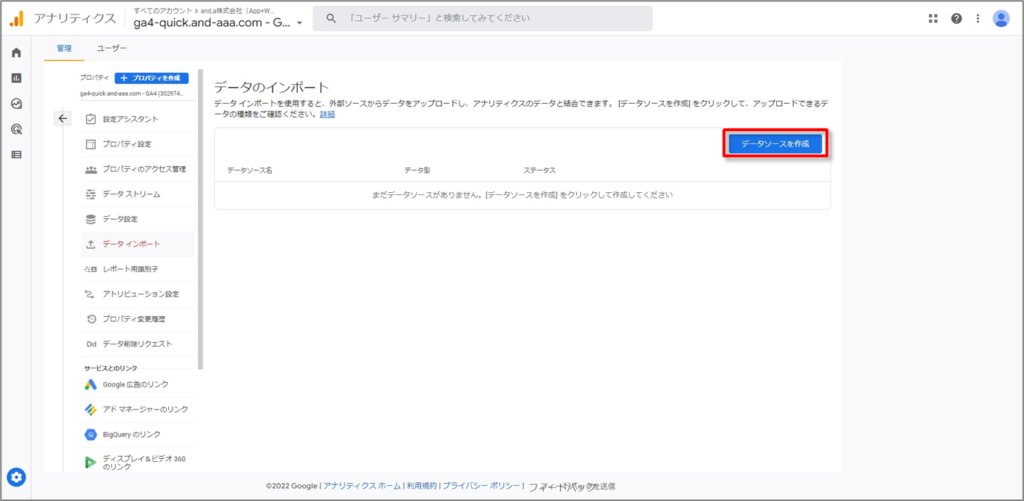

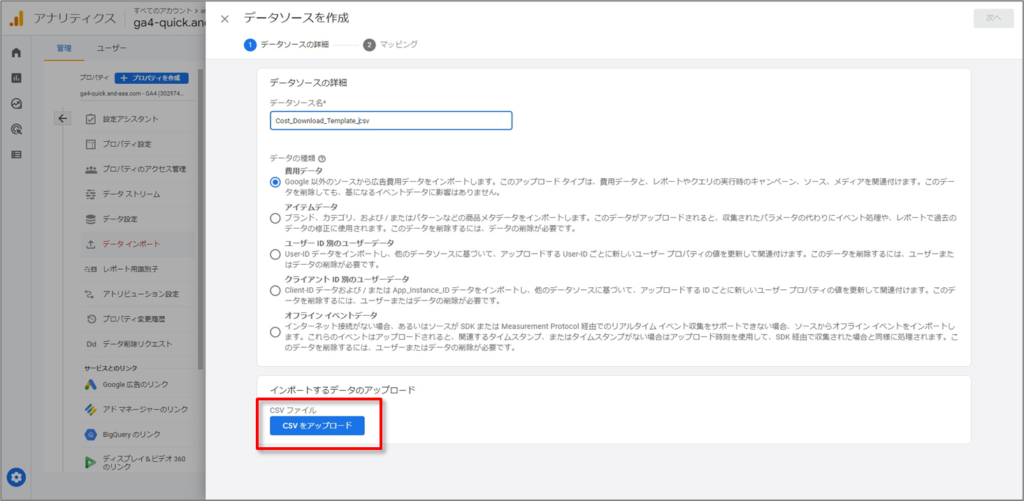

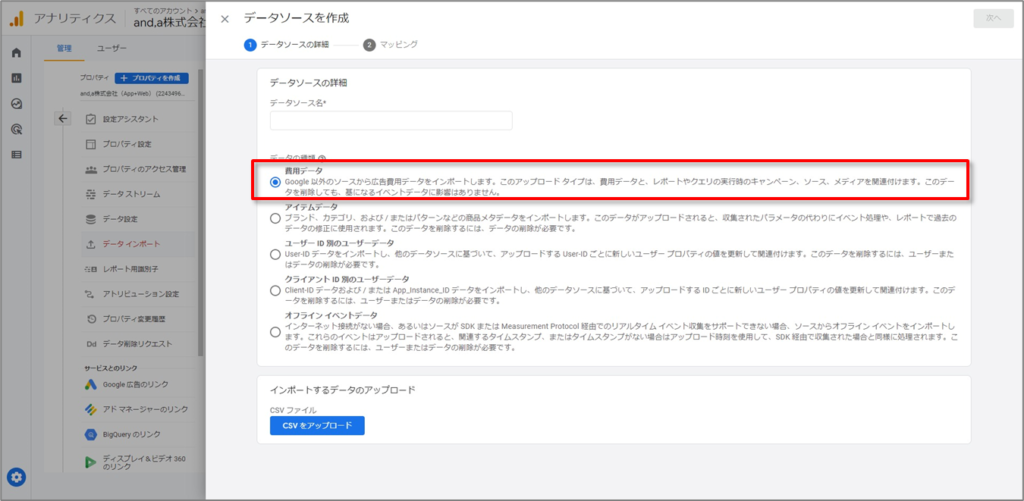

「データソースを作成」 をクリックします。

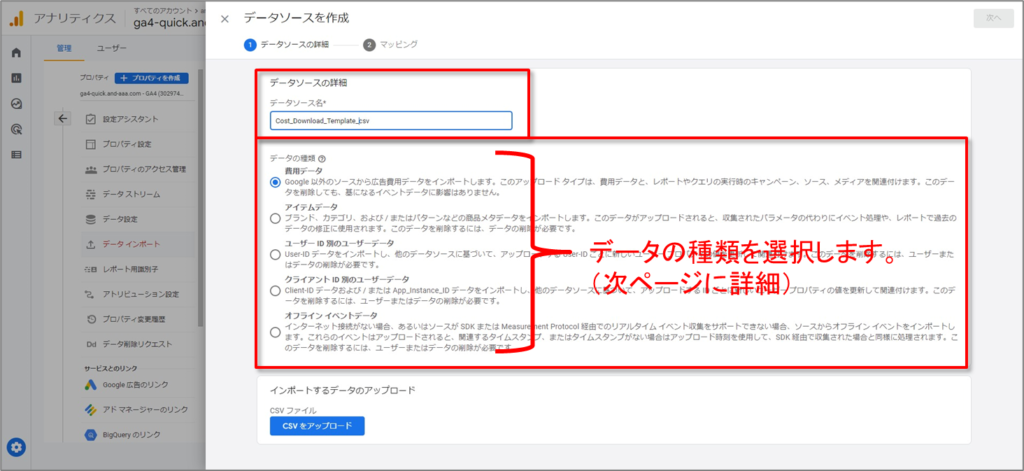

データソースに名前を付けます。

データの種類を選択します。

データの種類

| データの種類 | 解説 |

| 費用データ | Google 以外のソースから広告費用データをインポートします。このアップロード タイプは、費用データと、レポートやクエリの実行時のキャンペーン、ソース、メディアを関連付けます。このデータを削除しても、基になるイベントデータに影響はありません。 |

| アイテムデータ | ブランド、カテゴリ、および / またはパターンなどの商品メタデータをインポートします。このデータがアップロードされると、収集されたパラメータの代わりにイベント処理や、レポートで過去のデータの修正に使用されます。このデータを削除するには、データの削除が必要です。 |

| ユーザー ID 別のユーザーデータ | User-ID データをインポートし、他のデータソースに基づいて、アップロードする User-ID ごとに新しいユーザー プロパティの値を更新して関連付けます。このデータを削除するには、ユーザーまたはデータの削除が必要です。 |

| クライアント ID 別のユーザーデータ | Client-ID データおよび / または App_Instance_ID データをインポートし、他のデータソースに基づいて、アップロードする ID ごとに新しいユーザー プロパティの値を更新して関連付けます。このデータを削除するには、ユーザーまたはデータの削除が必要です。 ※「ユーザー ID」と「クライアント ID」については、当セミナーサイトのこちらの解説記事をご参照ください。 https://ga4-quick.and-aaa.com/archives/1092 |

| オフライン イベントデータ | インターネット接続がない場合、あるいはソースが SDK または Measurement Protocol 経由でのリアルタイム イベント収集をサポートできない場合、ソースからオフライン イベントをインポートします。これらのイベントはアップロードされると、関連するタイムスタンプ、またはタイムスタンプがない場合はアップロード時刻を使用して、SDK 経由で収集された場合と同様に処理されます。このデータを削除するには、ユーザーまたはデータの削除が必要です。 |

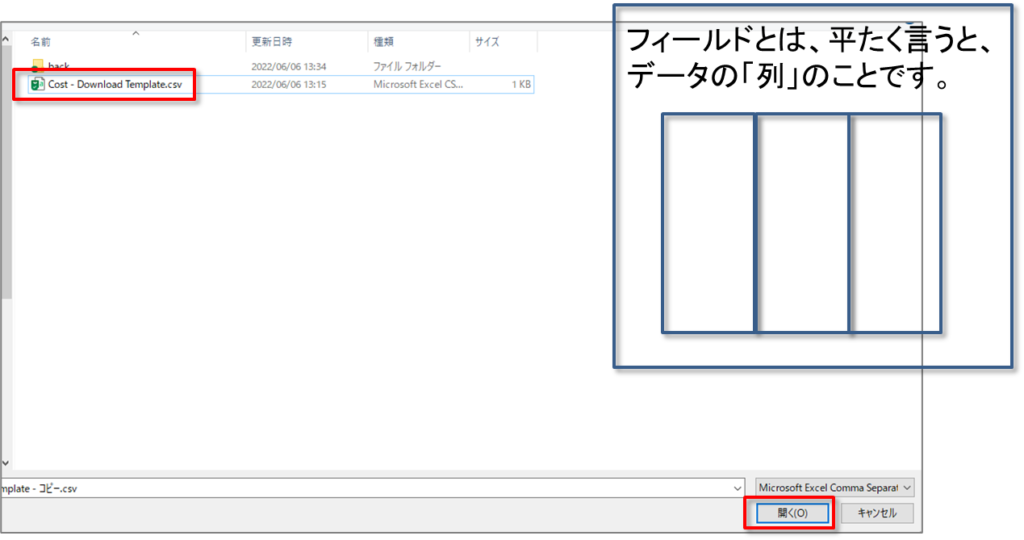

データの種類を選択したら、「CSV をアップロード」をクリックします。

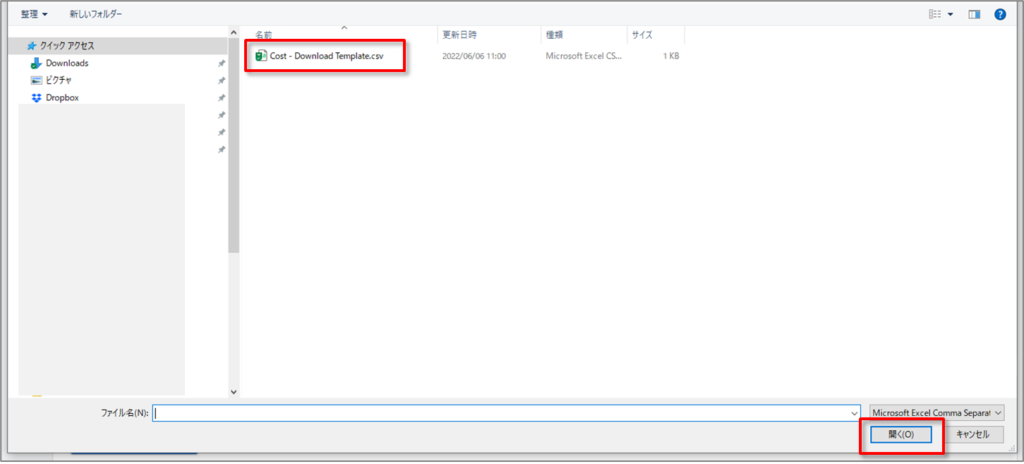

パソコン上の CSV ファイルを選択して 「開く」 をクリックします。

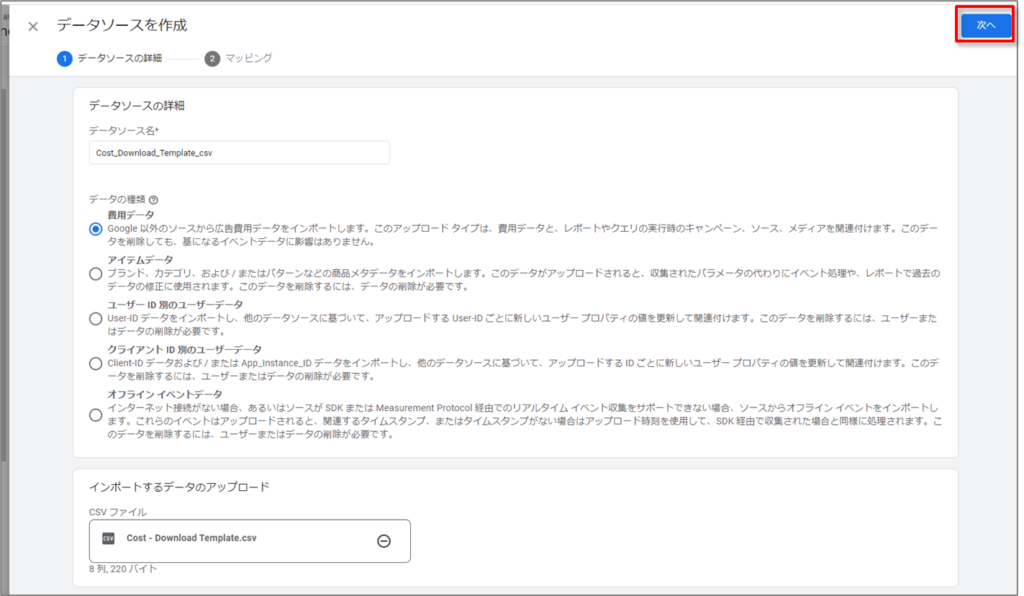

「次へ」をクリックして、マッピングに進みます。

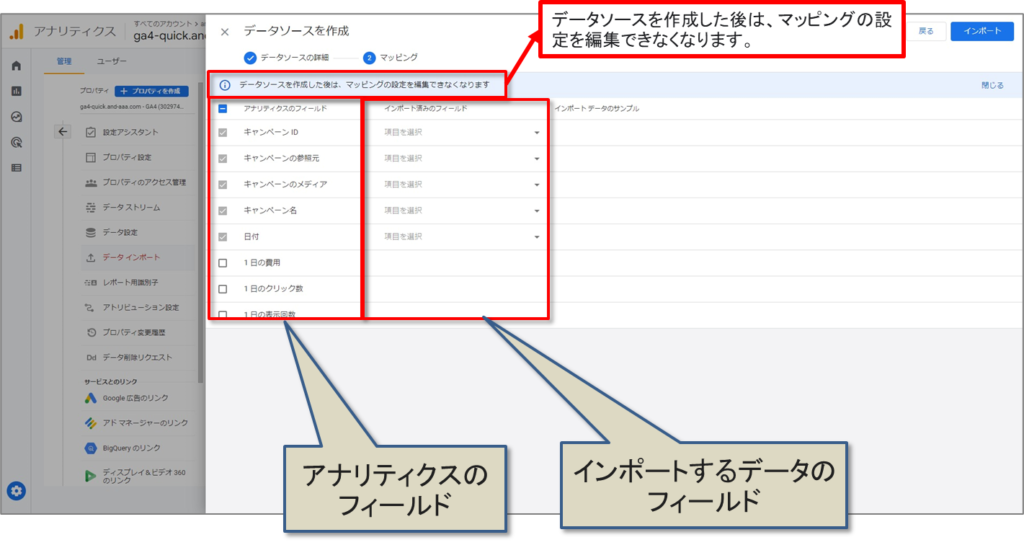

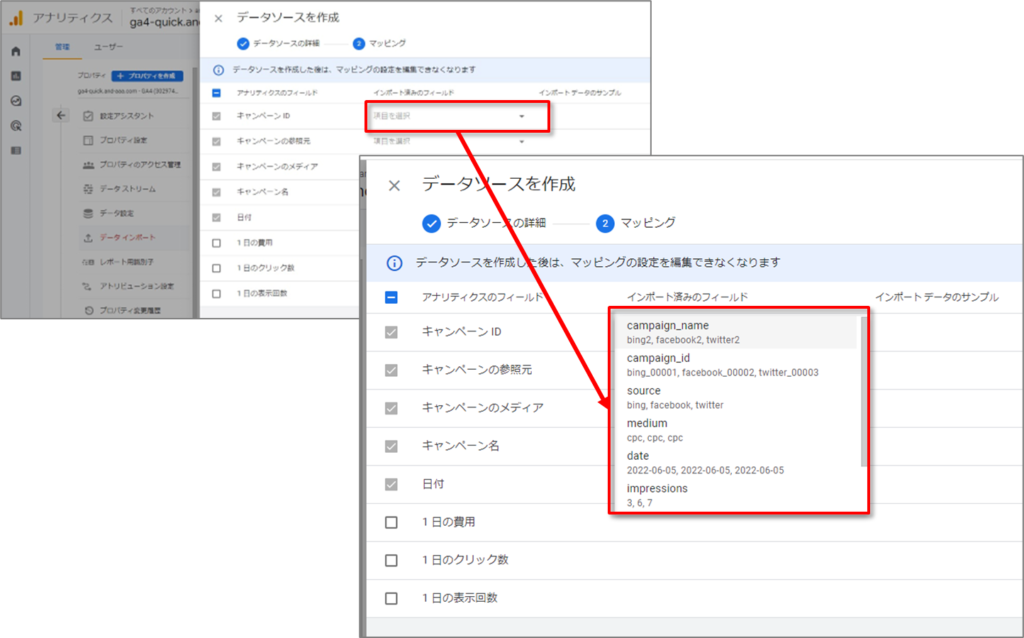

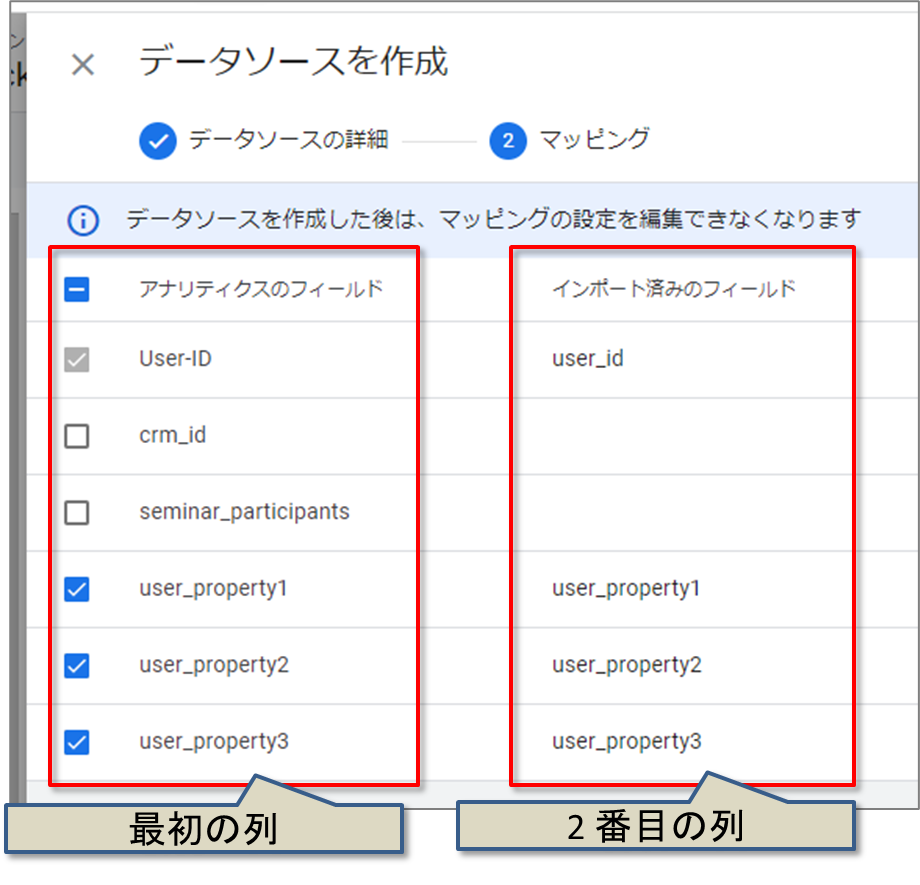

互いにマッピングする、「アナリティクスのフィールド」と「インポートするデータのフィールド」を選択します。必要に応じてフィールド名を編集します。

「アナリティクスのフィールド」と「インポートするデータのフィールド」の選択が終わったら、

「インポート」をクリックします。

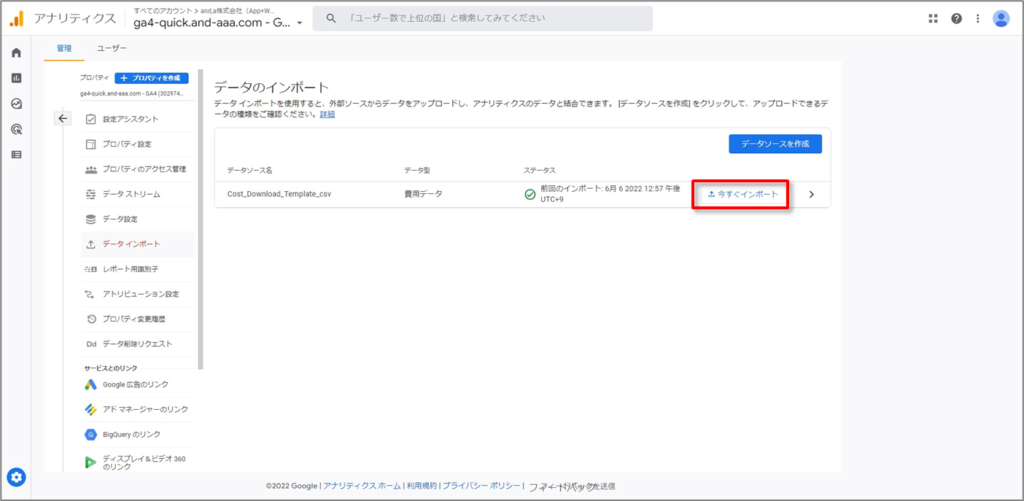

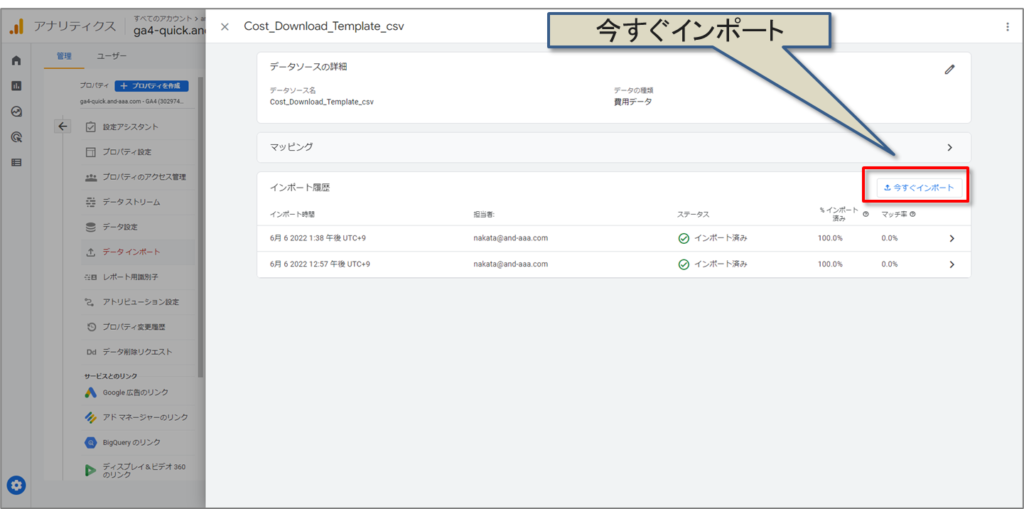

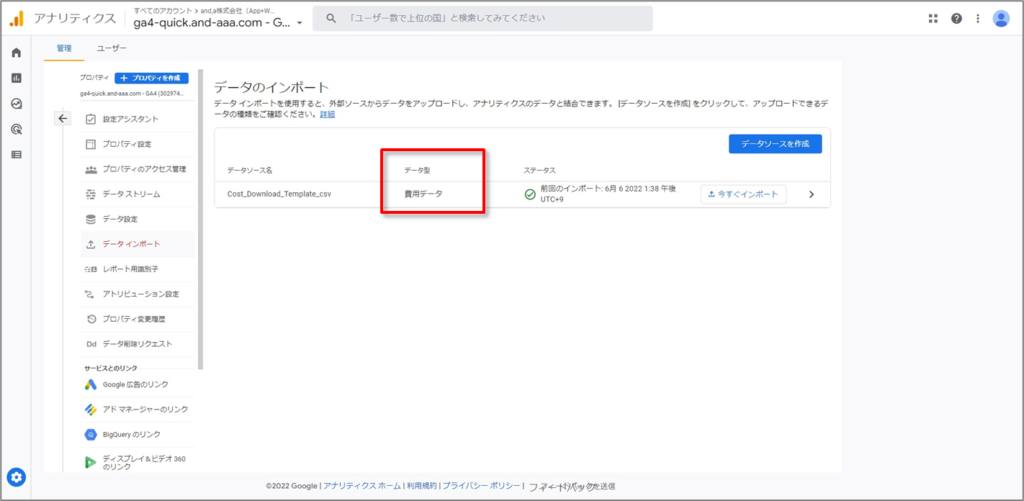

既存のデータソース(既にインポートしてあるデータソース)にデータをアップロードする

既存のデータソースにデータをアップロードする

既存のデータソースの行の 「今すぐインポート」をクリックします。

データソースが CSV のインポート用に設定されている場合は、インポートする CSV ファイルを選択して「開く」をクリックします。

CSV ファイルには元のフィールドと同じフィールドか、フィールドのサブセットが含まれている必要があります。同じデータタイプに対して異なるフィールドをインポートする場合は、既存のデータソースを削除し、新しいデータソースを作成する必要があります。

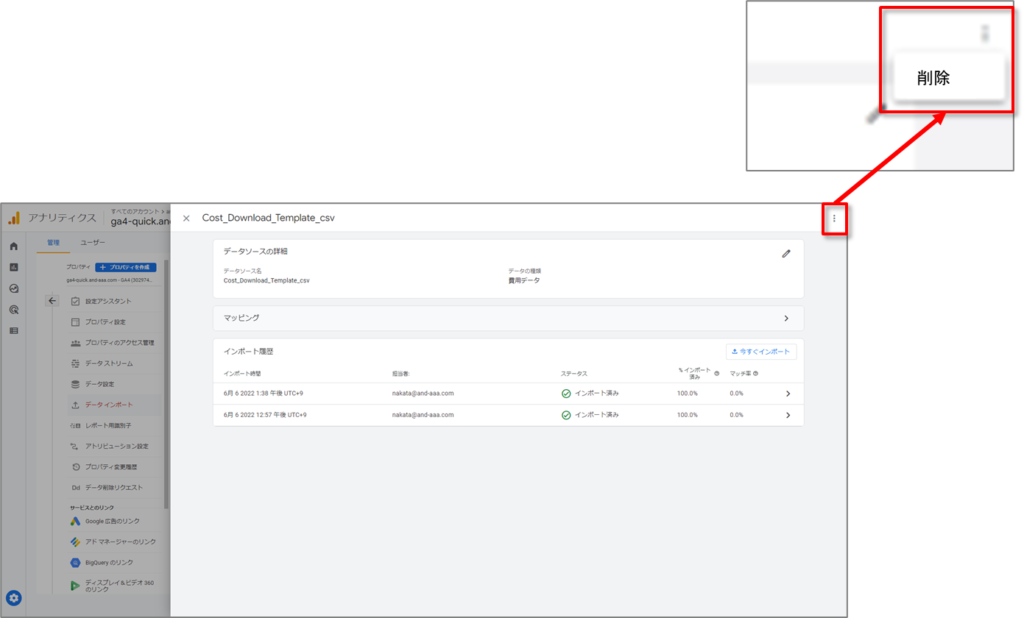

データソースの詳細の表示、新規データのインポート、データソースの削除

データソースの詳細の表示、新規データのインポート、データソースの削除について解説します。

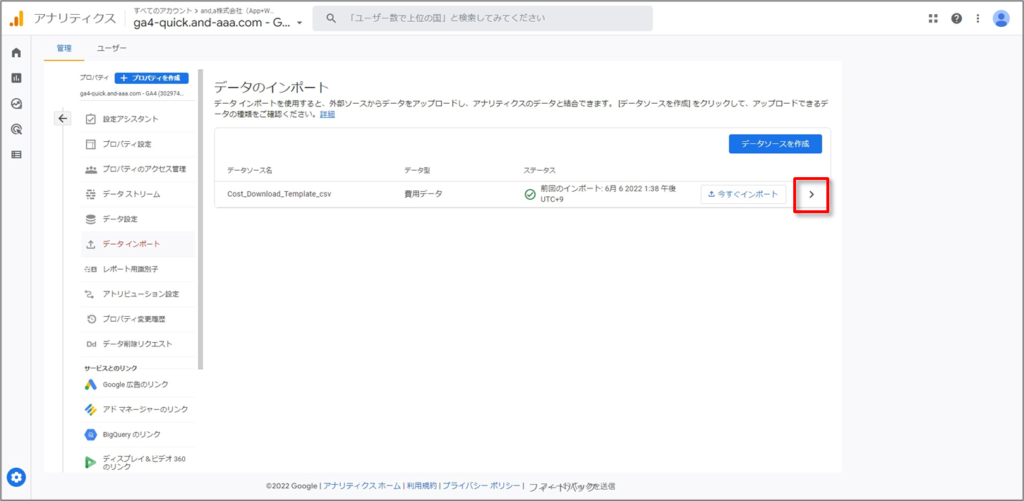

管理 > プロパティ列 > データインポート をクリック。

目的のデータソースの行の 「>」 をクリックします。

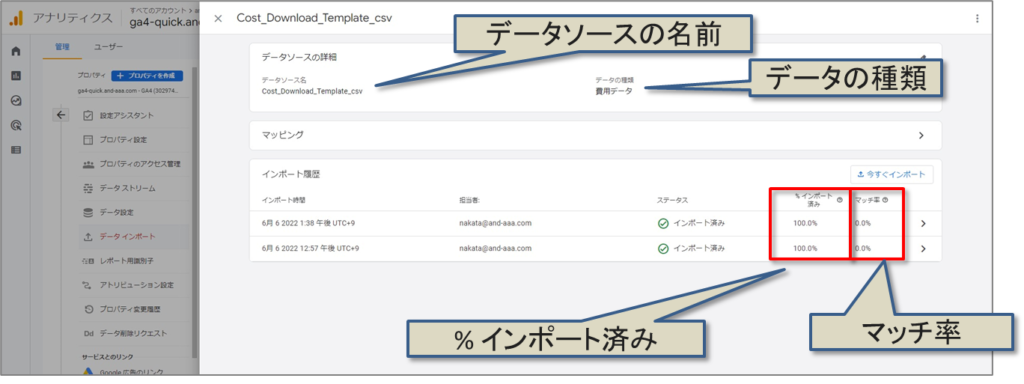

データソースの名前、データの種類、マッピング、アップロード毎の履歴を確認できます。

- % インポート済み: 正常にインポートされた行数を、インポート ファイルの行数で割った値です。すべての行が正常にインポートされると、100% になります。

- マッチ率: プロパティにあるインポート ファイルのキーの割合です(過去 90 日間)。過去 90 日間のデータが完全に関連しており実用的な場合は、100% になります。

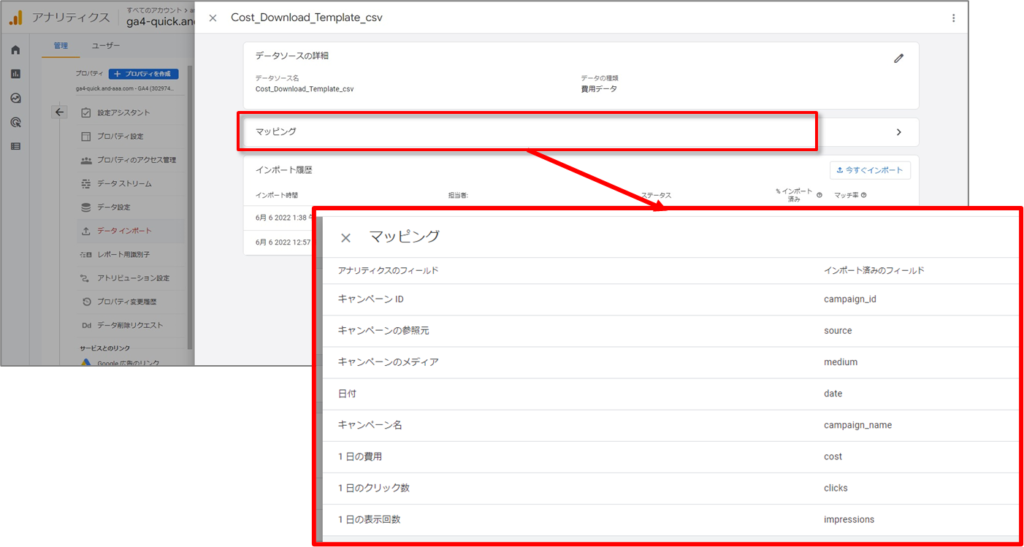

マッピングを確認できます。

新しいデータをインポートするには: 「今すぐインポート」をクリックし、ご使用のパソコンにある CSV ファイルを選択します。

データソースを削除する方法

全ページで見た3点アイコンをクリックし、削除をクリックします。

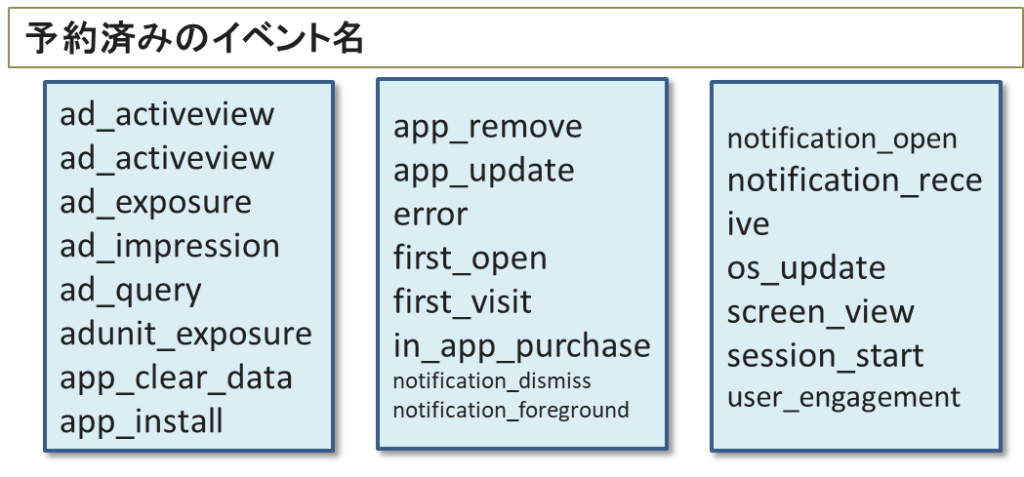

予約済みの名前および接頭辞

次の「イベント名」「イベント パラメータ名」「ユーザー プロパティ名」および「接頭辞」は、アナリティクスが使用するため予約されています。予約済みの名前や接頭辞と合致する内容を含むデータをアップロードしようとしても、該当データはアップロードされません。

例:

- 予約済みの名前と同名のイベントのインポートを試みた場合、該当イベントおよびそのパラメータはインポートされません。

- インポートを試みたイベントの名前には問題がないものの、パラメータに予約済みの名前が使用されている場合、イベント自体はインポートされますが、予約済みの名前を含むパラメータはインポートされません。

データソースについて

「データソース」とは、アナリティクスにアップロードしたデータを保存するコンテナです。アップロードしたデータと既存データとの結合方法は、データソースによって制御されます。データソースの設定はプロパティ レベルで行います。データソースは、データのアップロードに繰り返し使用できます。

プロパティに含まれるデータソースを管理するには、

管理 > プロパティ列 > データ インポート の順にクリックします。

公式ヘルプ:https://support.google.com/analytics/answer/10071145?hl=ja&ref_topic=10054560

データソース タイプ

データソース タイプは、インポートするデータの種類と対応します。たとえば、「費用データ」「商品アイテムデータ」「ユーザーデータ」などの「データ型(データソース タイプ)」が存在します。データのアップロード先として使用できるディメンションと指標(スキーマ=データベースの構造)は、データソース タイプごとに異なります。

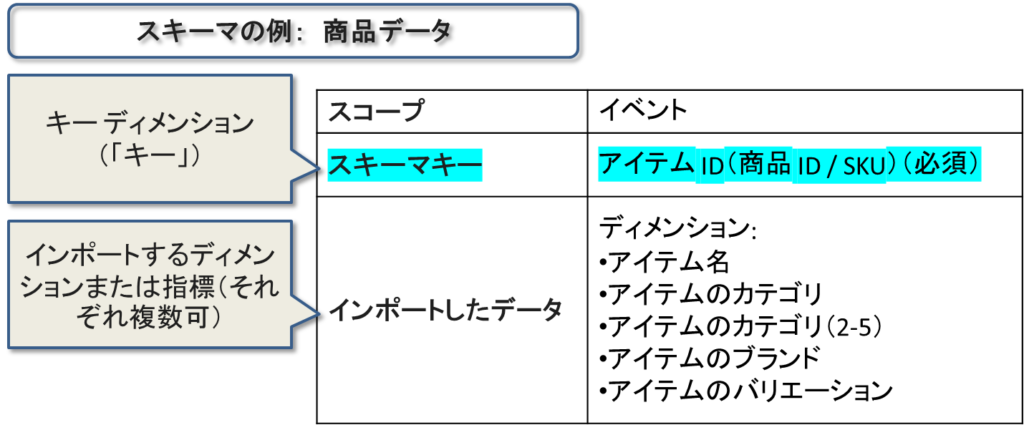

データソース スキーマ

データソースを作成する際はスキーマを定義します。スキーマとは、アップロードしたデータを既存のイベントデータと結合するための構造です。

単純なスキーマは、キー ディメンション(「キー」)1 つと、インポートするディメンションまたは指標(それぞれ複数可)から成ります。

公式ヘルプ:https://support.google.com/analytics/answer/10071145?hl=ja&ref_topic=10054560

下記の例は、商品データです。

データをインポートする際、 GA4 はイベントデータのキー値の中から、アップロードしたデータのキー値と一致するものを探します。一致する値が見つかると、そのキーに関連付けられているディメンションと指標の値が、既存のイベントデータに追加されます(収集済みのデータが存在する場合は、アップロードしたデータに差し替えられます)。データソースのタイプによっては、複数のディメンションでキーを定義することもできます。インポート フィールドでは、ほとんどのデータソース タイプで複数のディメンションや指標を使用できます。

詳細: 「商品データのインポート」(後述、公式ヘルプ:https://support.google.com/analytics/answer/10071144)と「ユーザーデータのインポート」(後述、公式ヘルプ: https://support.google.com/analytics/answer/10071143 )

費用データをインポートする

キーおよびインポート ディメンション

重複したキーを含むファイルはアップロードしないでください。レポートのデータに不整合が発生する原因となる場合があります。

「費用データ」のインポートを活用することで、オンライン広告やマーケティングへの投資を包括的に分析して、投資収益率(ROI)を割り出したり、各キャンペーンのパフォーマンスを比較したりすることができます。

費用データのインポートの仕組み

費用データのインポートでは、メール マーケティング キャンペーンやソーシャル メディア広告など、Google 以外のキャンペーンで生成されたデータをインポートします。

公式ヘルプ:https://support.google.com/analytics/answer/10071305?hl=ja&ref_topic=10054560

GA4 はこのデータを収益データおよびコンバージョン データと結合して、キャンペーン、ソース、メディアごとに、Google 以外のクリック単価やコンバージョン、Google 広告以外の費用対効果などの指標を算出します。これにより、さまざまな広告活動のパフォーマンス データをシームレスに比較できます。

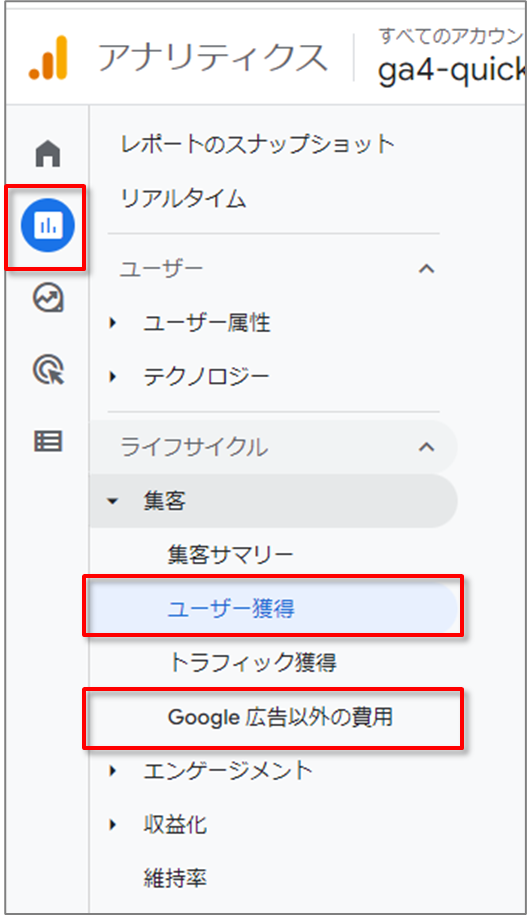

このデータは、「ユーザー獲得」と「Google 広告以外の費用」レポートで確認できます。

実際の広告の費用はキャンペーンの実施中に変化するため、同じキャンペーン ID のデータを定期的にアップロードすることで、レポートとデータ探索に最新の値が使用されます。

費用データのインポートの仕組み カスタム キャンペーン URL の役割

| リティクスのディメンション名 | カスタム キャンペーン パラメータ | アナリティクスで設定される値 |

| キャンペーン ID | utm_id | 123_1a2b3c_abc |

| ソース | utm_source | ad network |

| メディア | utm_medium | cpc |

GA4 プロパティでは、リンク先 URL で、

キャンペーン ID(utm_id)、

ソース(utm_source)、

メディア(utm_medium)

を指定する必要があります。

これで、アナリティクスはセッションと関連付けられたキャンペーン トラッキング パラメータを取得し、アナリティクス データと外部の費用データソースを結合できます。

URL には、キャンペーン名(utm_campaign)、キャンペーンのキーワード(utm_term)、キャンペーンのコンテンツ(utm_content)など、これまでユニバーサル アナリティクス プロパティで使用されていたパラメータを追加できます。ただし、これらのパラメータは必須ではなく、インポート ファイルに含めることはできません。

データをアップロードする

「利用規約を確認してください」と表示された場合は、確認してください。

費用のディメンションと指標の CSV ファイルを作成します(サンプルは下に掲載)。

データをアップロードする

アップロードの一般的な手順については、この記事の前のパートで説明してあります。

データソースを作成する際は、「費用データ」を選択します。

最初の列には次の情報が表示されます。

- データを結合するアナリティクス フィールド(この例の場合は、「キャンペーン ID」「キャンペーンの参照元」「キャンペーンのメディア」「日付」)。「スキーマキー」とも呼ばれます。

- CSV のフィールドと一致するキャンペーンのディメンションと指標(例: 「キャンペーン名」「1 日の費用」など)。

「キャンペーン ID」「キャンペーンの参照元」「キャンペーンのメディア」は、リンク先 URL で使用したカスタム キャンペーン パラメータ(utm_id、utm_source、utm_medium)と一致します。

2番目の列では、CSVで一致するフィールドを選択します。

データをアップロードしてから、レポート、オーディエンス、データ探索でそのデータを使用できるようになるまでには、最大 24 時間ほどかかります。指標とキャンペーン プロパティをユーザー アクティビティに関連付けるには、データのアップロード後にユーザーがキャンペーンで操作を行う必要があります。

指標とディメンション値を上書きするには、新しい指標と値をアップロードします。

(以下、「費用データ」「アイテムデータ」「ユーザーデータ」「オフライン イベントデータ」共通)

データ アップロード サービスから費用データソースを削除しても、関連するキャンペーンのディメンションと指標に保存されている値は削除されません。データ インポートでアップロードしたデータを完全に削除するためには、他の収集手法の場合と同様に、ユーザー削除やデータ削除が必要となることもあります。

データソースの詳細

凡例

- スコープ: インポート ディメンション値に関連付けるイベントを指定します。スコープには、ヒット、セッション、ユーザー、商品の 4 つのレベルがあります。(スコープの詳細: https://support.google.com/analytics/answer/2709828#scope&zippy=%2C%E3%81%93%E3%81%AE%E8%A8%98%E4%BA%8B%E3%81%AE%E5%86%85%E5%AE%B9 )

- スキーマ: インポートしたデータの構造を構成するディメンションと指標を指定します。アップロード ファイルのヘッダーは、該当するデータソースについて定義したスキーマと一致する必要があります。 スキーマとして示しているディメンションと指標はあくまで参考用で、すべてが網羅されていない可能性があります。実際に使用できるディメンションと指標は、データソースの作成時に管理画面に表示されます。

| スコープ | このデータは、1 日ごとの集計データであり、セッションやユーザーをまたいでさまざまなイベントをまとめたものなので、スコープが存在しません。 |

| スキーマ | 次のディメンションは必須です。 •キャンペーン ID(utm_id) •ソース(utm_source) •メディア(utm_medium) •日付(ISO 8601: YYYY-MM-DD) 次のディメンションは省略可能ですが、指定することをおすすめします。 •名前 次の指標を 1 つ以上含める必要があります。 •クリック数(1 日の値。省略可) •費用(0,000.00 形式の 1 日の値。省略可だが通常含まれる) •インプレッション数(1 日の値。省略可) |

テンプレート 以下は、費用データの CSV テンプレートのサンプルです。

campaign_name,campaign_id,source,medium,date,impressions,clicks,cost

bing,bing_11111,bing,cpc,2022-06-06,1,1,1

facebook,facebook_22222,facebook,cpc,2022-06-06,2,2,2

twitter,twitter_33333,twitter,cpc,2022-06-06,4,4,4

公式ヘルプから、費用データの CSV インポート用テンプレートをダウンロードするhttps://storage.googleapis.com/support-kms-prod/sOc7Qcdy1akKPr9GmwdQSIcesn4eLPBn84Na

[参考] 他のプラットフォームから費用データをインポートする

公式ヘルプ:https://support.google.com/analytics/answer/10071305?hl=ja&ref_topic=10054560

このセクションでは、キャンペーンの費用データを各種プラットフォーム(Facebook、Twitter、Microsoft など)からエクスポートする際の一般的なガイドライン、および各プラットフォームのネイティブ ドキュメントへのリンクを記載しています。

これらのプラットフォームは、アナリティクスで使用できるものと同じ形式でデータを提供するとは限りません。したがって、これらのプラットフォームからエクスポートしてアナリティクスにインポートするデータが、アナリティクスで使用可能な形式(ID、ソース、メディア、日付など)であるかどうかを確認する必要があります。

エクスポートするデータが、次の必須、推奨、または省略可の各ディメンションと指標に一致することを確認してください。また、ここにないものが含まれないようにしてください。

- ID(必須)

- ソース(必須)

- メディア(必須)

- 日付(必須)

- 名前(省略可だが推奨される)

- 費用(省略可だが通常含まれる)

- クリック数(省略可)

- 表示回数(省略可)

キャンペーン ID の収集

以下に示すベンダーを含めた多数のベンダーが、クリック ターゲット(エンドユーザーがクリックするサイトへのリンク)内にキャンペーン ID、名前、ソース、メディアを追加するためのさまざまな仕組みを提供しています。ベンダーが提供する自動入力機能が利用可能な場合は、使用することをおすすめします。自動入力機能を利用できない場合は、完全な URL をベンダーに直接提供しなければならない場合があります。

Facebook の広告マネージャ( https://www.facebook.com/business/help/849477685213347 )を使用してデータをエクスポートします。

- 広告マネージャでエクスポートとインポートのアイコンをクリックします。

- エクスポートをカスタマイズするオプションを選択して、上記のディメンションと指標を含めます。

関連資料

広告マネージャのフィールド名とインポート/エクスポート用スプレッドシートの列名の違い( https://www.facebook.com/business/help/1462433740708893 )

Firebase Android アプリ

campaign_details イベントを使用すると、ウェブ キャンペーン用の utm_id で収集されるものと同等の情報を収集できます。

FirebaseAnalytics.Param.CP1(カスタム パラメータ)を使用して情報を収集することもできます。

Firebase iOS アプリ

AnalyticsParameterCampaign( https://firebase.google.com/docs/reference/swift/firebaseanalytics/api/reference/Constants#/c:FIRParameterNames.h@kFIRParameterCampaign ) 定数を使用すると、ウェブ キャンペーン用の utm_id で収集されるものと同等の情報を収集できます。

キャンペーンマネージャー( https://www.linkedin.com/help/lms/answer/a441785/export-reports-in-campaign-manager )を使用して、キャンペーン データをエクスポートします。

[レポートの種類] に [キャンペーンのパフォーマンス] を選択すると、CSV のエクスポートに使用する [列ビュー] を選択できます。

上記のディメンションと指標のみを選択してください(それ以外を選択すると、インポートは失敗します)。

関連資料

- キャンペーンマネージャーでエクスポートできるレポート( https://www.linkedin.com/help/lms/answer/a452049 )

- キャンペーンマネージャーのパフォーマンス メトリック( https://www.linkedin.com/help/lms/answer/a445476 )

Microsoft

Microsoft Advertising( https://about.ads.microsoft.com/en-my/resources/training/microsoft-advertising-reports ) のレポートを使用して、データの CSV ファイルをエクスポートできます。

上記のディメンションと指標を含むキャンペーン レポートを作成します。

[ダウンロード] オプションを使用してデータをエクスポートします。

Microsoft Advertising Editor( https://about.ads.microsoft.com/en-us/resources/training/microsoft-advertising-editor-exporting-and-importing ) を使ってキャンペーンのデータをエクスポートすることもできます。

キャンペーンのダッシュボードの右上にある [エクスポート] オプションでキャンペーン データの CSV ファイルをエクスポート( https://business.twitter.com/ja/help/campaign-measurement-and-analytics/export-csv-definitions.html )できます。

Twitter ではソースとメディアのネイティブ サポートは提供されていません。ソースは「twitter」としてハードコーディング(値を直接書き込む)できます。メディアに指定する値は、各キャンペーン ID に使用する個々のメディアを反映している必要があります。

Verizon

Native Ad Platform( https://developer.verizonmedia.com/native/advertiser/guide/bulk/ ) の一括ファイルを使用すると、広告主アカウントからキャンペーン データをダウンロードして編集できます。

デフォルトのダウンロードには、アナリティクスにインポートできないその他のディメンションが含まれます。インポートする前にこれらの列を削除し、必要に応じて行を統合して、CSV ファイルに上記のディメンションと指標のみが含まれるようにする必要があります(この操作を行わないとインポートは失敗します)。

商品データのインポート

重複したキーを含むファイルはアップロードしないでください。レポートのデータに不整合が発生する原因となる場合があります。

近日提供予定(2022年6月7日現在): 商品データのプロセス実行時のデータ結合。プロセス実行時のデータ結合がサポートされると、オーディエンスやリマーケティングなど、アナリティクスの他の機能で商品データを利用できるようになります。

商品データのインポートを活用すると、商品カタログ全体を Google アナリティクスに取り込むことができます。これにより、ユーザー行動、サイトのトラフィック、e コマースの収益、コンバージョンなどを、サイズ、色、スタイルなどの商品固有データや、ビジネス内容に応じた商品のディメンションとともに測定することが可能です。

商品データをアナリティクスにインポートすると、イベントとともに送信する e コマース関連データを簡素化および削減できます。データ収集時にアイテム ID や SKU(Stock Keeping Unit、最小の管理単位) だけアナリティクスに送信しておけば、あとはインポート済みの商品データとの照合により、e コマース関連のディメンションや指標を取得してレポートに表示できるためです。

公式ヘルプ:https://support.google.com/analytics/answer/10071144?hl=ja&ref_topic=10054560

商品データのインポートの仕組み

この機能を使用するには、オンライン販売の推奨イベント(公式ヘルプ: https://support.google.com/analytics/answer/9267735?hl=ja )を収集している必要があります。

商品データのインポートでは、「商品アイテム ID」ディメンションをキーとして使用します。イベントとともに 1 つまたは複数のアイテム ID を送信することが可能です。

商品データのインポートでは、収集済みおよび収集中のイベントの item_id を、インポートした商品フィールドの値と紐付けることにより、当初収集した値の代わりに(オーディエンス、レポート、データ探索ツールでは)アップロードした値を表示します。

たとえば、レポート内で item_id が(個別に、または集計データとして)使用されていると、アナリティクスは当初収集した値をアップロードした値に置き換えてレポートに表示します。これにより、収集済みの値を修正またはアップデートすることができ、データの構造再編や再活用に役立ちます。また、クエリ時点で、まだ処理されていない新しいアップロード済みの値が存在する場合、アナリティクスは処理済みの値の代わりに新しい値を使用します。

データ アップロード サービスから商品データソースを削除しても、関係する商品の商品ディメンションに保存された値は(変更されている可能性があるため)削除されません。この方法でアップロードしたデータを完全に削除するためには、他の収集手法の場合と同様に、データ削除が必要となることもあります。

インポートされたデータは、処理が完了するまでレポートには表示されません。流入するイベントデータにインポート済みデータが適用されるようになるまで、処理完了から最大 24 時間かかることがあります。

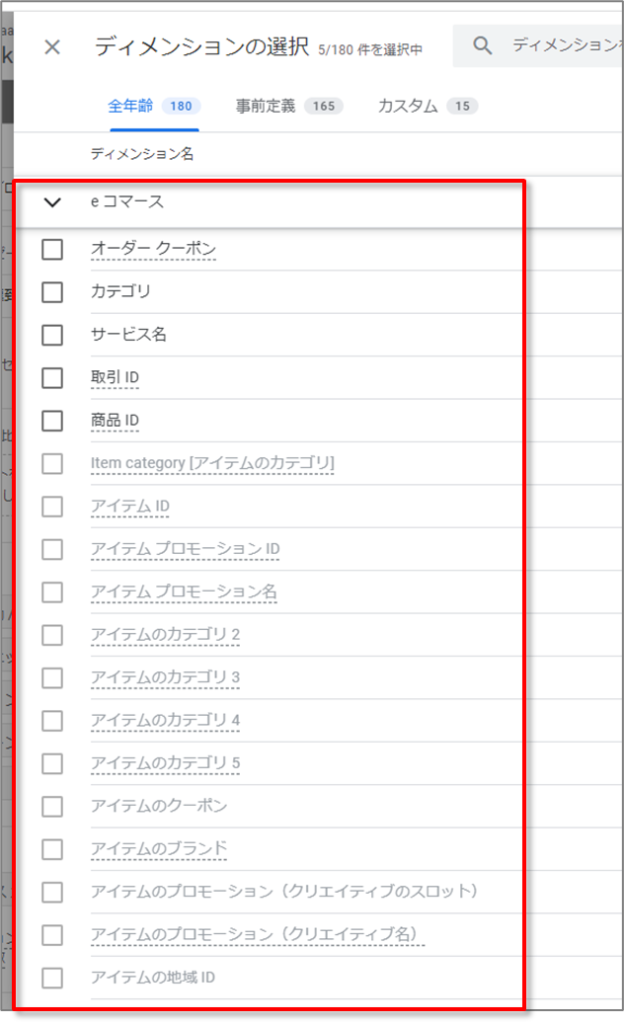

分析と対応

デフォルトの商品ディメンション(例: アイテムのブランド、アイテムのカテゴリ、アイテム名)が e コマースでの購入レポートに表示されます。

「データ探索ツール」の商品データは、「目標到達プロセス」と「セグメントの重複」の探索に使用できます。

※「探索」については、当セミナーの「探索」の回のアーカイブをご参照ください。

また 「データ探索ツール」 では、インポートした商品データをもとに、ユーザーをショッピング行動に応じてセグメント化することが可能です。

探索「目標到達プロセス」

商品データは、「目標到達プロセス」と「セグメントの重複」の探索に使用できます。

※「探索」については、当セミナーの「探索」の回のアーカイブをご参照ください。

また 「データ探索ツール」 では、インポートした商品データを元に、ユーザーをショッピング行動に応じてセグメント化することが可能です。

CSV ファイルを作成する

商品ディメンションの CSV ファイルを作成します。次に例を示します。

item_id,item_name,item_cat1,item_cat2,item_cat3,item_cat4,item_cat5,brand,variant

p100001,itemname1,cat1a,cat2b,cat3c,cat4d,cat5e,brand_foo,variant_small

p100002,itemname2,cat1a,cat2b,cat3c,cat4d,cat5e,brand_bar,variant_medium

p100003,itemname3,cat1v,cat2w,cat3x,cat4y,cat5z,brand_bar,variant_large

公式ヘルプから、費用データの CSV インポート用テンプレートをダウンロードする

https://storage.googleapis.com/support-kms-prod/LL9lXx92bk5roVtXwJL8jMKkhHwvy0MjW4Kb

CSV ファイルをアップロードする

データをアップロードする

アップロードの一般的な手順については、前出の「データ インポートについて」に記載されています。

データソースを作成する際は、「商品データ」を選択します。

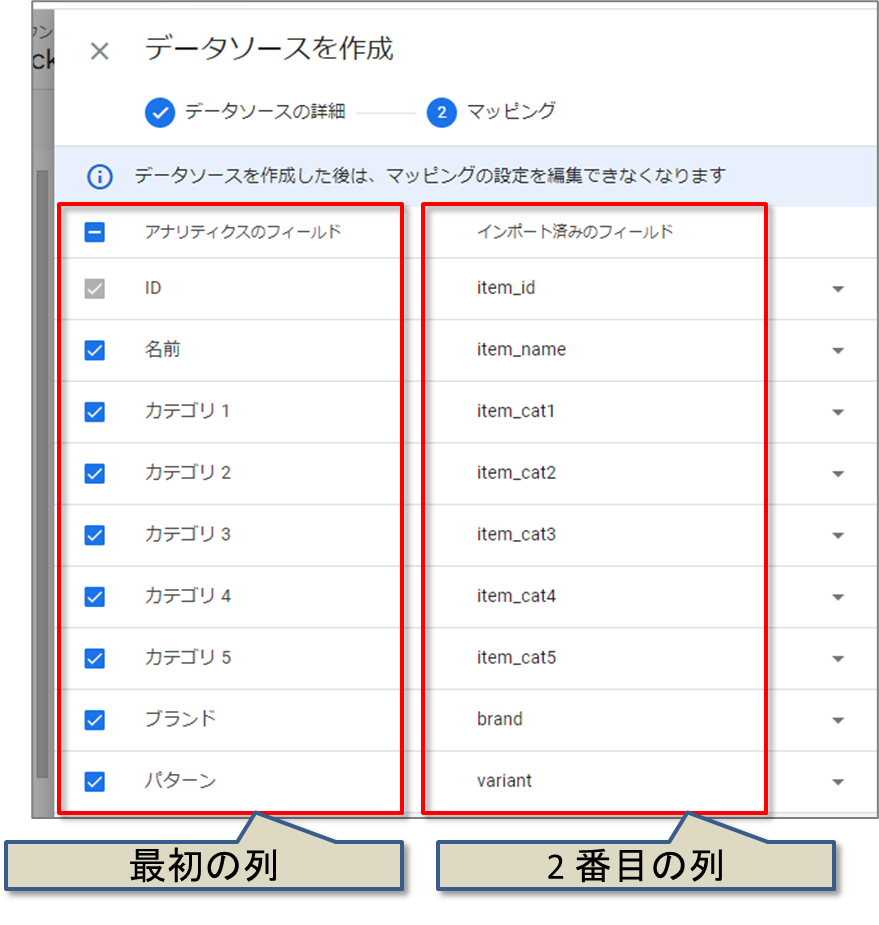

アナリティクスのフィールドをインポートしたフィールドにマッピングすると上記のように表示されます。

最初の列には次の情報が表示されます。

データの結合先となるアナリティクス フィールド(この場合は ID)。「スキーマキー」とも呼ばれます。

CSV のフィールドと一致する商品ディメンション(例: 名前、ブランドなど)。

2 番目の列では、CSV で一致するフィールドを選択します。

データをアップロードしてから、レポート、オーディエンス、データ探索でそのデータを使用できるようになるまでには、最大 24 時間ほどかかります。商品ディメンションをユーザー アクティビティに関連付けるには、データのアップロード後にユーザーが商品の操作を行う必要があります(商品詳細を見る、商品をカートに入れるなどのイベント) 。

ディメンション値を上書きするには、新しいディメンションをアップロードします。

(以下、「費用データ」「アイテムデータ」「ユーザーデータ」「オフライン イベントデータ」共通)

データ アップロード サービスから商品のデータソースを削除しても、関連する商品のディメンションに保存されている値は削除されません。データ インポートでアップロードしたデータを完全に削除するためには、他の収集手法の場合と同様に、ユーザー削除やデータ削除が必要となることもあります。

データソースの詳細

| スコープ | イベント |

| スキーマキー | アイテム ID(商品 ID / SKU)(必須) |

| インポートしたデータ | ディメンション: •アイテム名 •アイテムのカテゴリ •アイテムのカテゴリ(2-5) •アイテムのブランド •アイテムのバリエーション |

凡例

- スコープ: インポート ディメンション値に関連付けるイベントを指定します。スコープには、ユーザー、セッション、イベント、商品の 4 つのレベルがあります。商品データのインポートは、e コマース イベント内でアイテム スコープのメタデータを拡張するために使用されます。

- スキーマキー: キーとなるディメンションや指標を指定します。キーは、このデータソース タイプにおいて、イベントに含まれる既存データとアップロードしたデータを紐付けるために使用されます。

- インポートしたデータ: アナリティクスにアップロードしたデータで使用できるディメンションと指標です。

スキーマとして示しているディメンションと指標はあくまで参考用で、すべてが網羅されていない可能性があります。実際に使用できるディメンションと指標は、データソースの作成時に管理画面に表示されます。

ユーザーデータをインポートする

重複したキーを含むファイルはアップロードしないでください(例: user_id という名前の 2 つのフィールド)。

アナリティクス以外に保存されているユーザーのメタデータ(CRM システムから抽出した「リピート率」「最後の購入日」「顧客のライフタイム バリュー」など)をインポートすることで、ユーザー セグメントやリマーケティング オーディエンスを拡張することができます。

ユーザーデータを正常にインポートするには、次のいずれかのキーを使ってデータをアナリティクス データと結合できる必要があります。

- ストリーム ID(次ページ参照) と、アナリティクスで生成されたクライアント ID(ウェブの場合)またはアプリ インスタンス ID(アプリの場合)。

- ユーザーごとに生成する固有 ID。たとえば、ウェブサイトやアプリの認証サービスからユーザー ID を取得するか、CRM システムから抽出します。得られた固有 ID(エンドユーザーのプライバシー保護のためハッシュ化したもの 公式ヘルプ: https://support.google.com/analytics/answer/6366371 )を測定コードに追加し、イベントとともにアナリティクスに送信します。

アナリティクスでは、

1)ストリーム ID と、クライアント ID またはアプリ インスタンス ID、

あるいは

2)固有 ID をキーとして使用して、アップロードしたデータにユーザー

がマッピングされます。

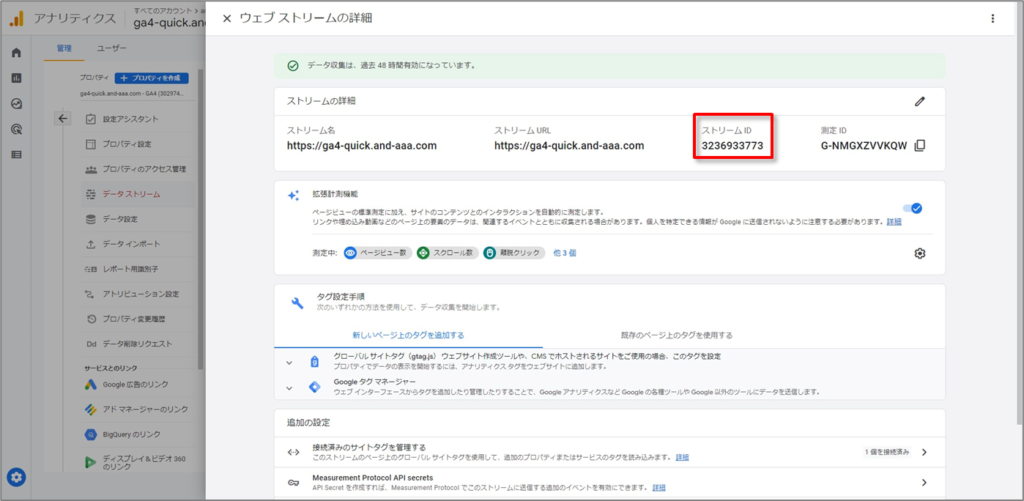

ストリーム ID を確認する

管理 > プロパティ列 > データ ストリーム をクリックして、目的のデータ ストリームを開きます。

「ストリームの詳細」に「ストリーム ID」が表示されています。

ストリーム ID とアプリ インスタンス ID を使用して、アップロードしたデータにユーザーをマッピングする場合

ストリーム ID とアプリ インスタンス ID を使用して、アップロードしたデータにユーザーをマッピングする場合、アプリのインストールのたびに新しいアプリ インスタンス ID が割り当てられる点に注意してください。

ユーザーがアプリをアンインストールして再インストールした場合、再インストール前と後に収集されたデータはそれぞれ 2 つの異なるアプリ インスタンス ID に関連付けられるため、ユーザーも別々に関連付けられます。アプリ インスタンス ID がアプリの更新にあわせて変更されることはありません。

アップロードしたデータはユーザー ディメンション( https://support.google.com/analytics/answer/9268042 )に保存され、アップロード以降、このプロセスによって識別されたユーザーが発生させるすべてのイベントと関連付けられます。

参考:「ユーザーID」 アナリティクスでユーザー ID を保存する

アナリティクスでユーザー ID を保存する方法には次の 2 種類があります。

•ユーザー ID ディメンションを使用

詳しくは、ユーザー ID を設定する方法( https://support.google.com/analytics/answer/9213390 )をご覧ください

•カスタム ディメンションを使用(スコープをユーザーに設定し、ユーザー プロパティでユーザー識別子を取得)

詳しくは、アナリティクスへの個人情報の送信を避ける( https://support.google.com/analytics/answer/6366371 )ためのおすすめの方をご覧ください

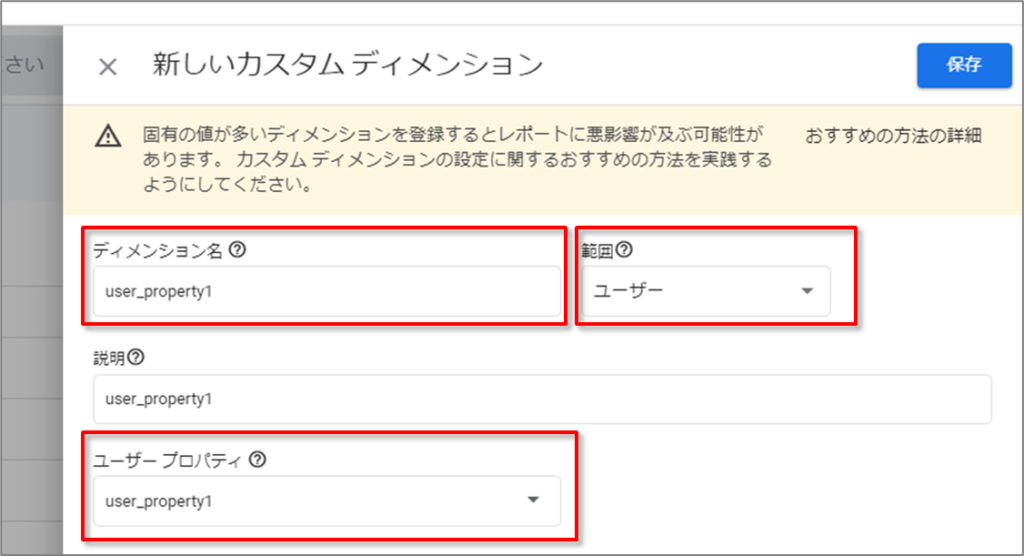

カスタム ディメンションを作成する

インポートする値向けにユーザー スコープのカスタム ディメンション( https://support.google.com/analytics/answer/10075209 )を作成します。

カスタム ディメンションの作成後、インポートするデータを認識できるようになるまでには、最大で 4 時間ほどかかります(カスタム ディメンションが処理されていることを確認するには、データ探索を開き、ディメンション選択ツールでユーザー プロパティが表示されるかどうかを確認します)。

CSV ファイルを作成する

ユーザー識別子とユーザー プロパティの値の CSV ファイルを作成します。

例:

user_id,user_property1,user_property2,user_property3

123abc,user1 value 1,user1 value 2,user1 value 3

456def,user2 value 1,user2 value 2,user2 value 3

789ghi,user3 value 1,user3 value 2,user3 value 3

公式ヘルプから、ユーザーデータの CSV インポート用テンプレートをダウンロードするhttps://storage.googleapis.com/support-kms-prod/q66XiUacu9BuRR68sfFntDY72qefzqOx69mk

データをアップロードする前に、カスタム ディメンションを作成する

上記で例に挙げたCSVファイルをインポートする前に、

下記の3件をカスタムディメンションとして設定します。

user_property1

user_property2

user_property3

設定 > カスタム定義 > カスタムディメンションを作成

設定 > カスタム定義 において、

user_property1

user_property2

user_property3

を カスタム ディメンションを設定した状態となりました。

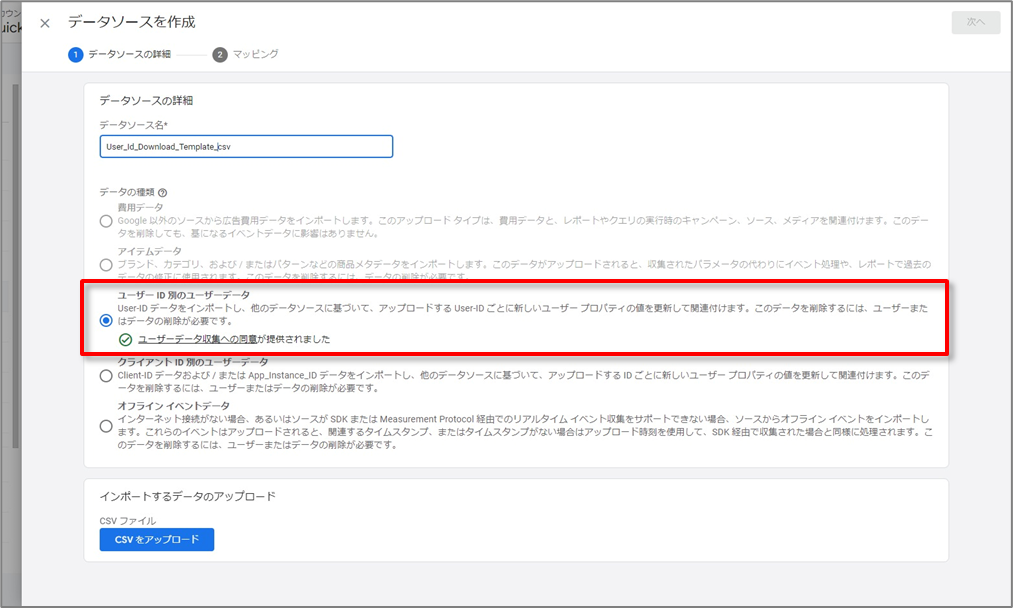

データをアップロードする

アップロードの一般的な手順については、前出のデータ インポートについてに記載されています。

データソースを作成する際は、ユーザーを識別するために使用している方法(ユーザー ID またはクライアント ID / アプリ インスタンス ID +ストリーム ID)に応じて、「ユーザー ID 別のユーザーデータ」 または 「クライアント ID 別のユーザーデータ」を選択します。

※「ユーザー ID」と「クライアント ID」については、当セミナーサイトのこちらの解説記事をご参照ください。

最初の列には次の情報が表示されます。

- データの結合先となるアナリティクス フィールド(この場合はユーザー ID)。「スキーマキー」とも呼ばれます。

- CSV のフィールドと一致する、アナリティクスで作成したカスタム ディメンションのユーザー プロパティ(左の例では、「user_property1」 「user_property2」 「user_property3」 。

2 番目の列では、CSV で一致するフィールドを選択します。

データをアップロードしてから、レポート、オーディエンス、データ探索でそのデータを使用できるようになるまでには、最大 24 時間ほどかかります。識別するユーザーのユーザー プロパティをユーザー アクションに関連付けるためには、データのアップロード後に、そのユーザーがサイトやアプリを利用する必要があります。

ユーザー ディメンション値を上書きするには、新しい値をアップロードするか、測定コードから新しい値を収集します。

(以下、「費用データ」「アイテムデータ」「ユーザーデータ」「オフライン イベントデータ」共通)

データ アップロード サービスからユーザー データソースを削除しても、関係するユーザーのユーザー ディメンションに保存された値は削除されません。データ インポートでアップロードしたデータを完全に削除するためには、他の収集手法の場合と同様に、ユーザー削除やデータ削除が必要となることもあります。

データソースの詳細

| スコープ | ユーザー |

| スキーマ キー | 次のいずれかです。 •クライアント ID + ストリーム ID •ユーザー ID |

| インポートしたデータ | ユーザー プロパティ |

| 備考 | ユーザーデータのインポートで、個人情報をアップロードしたり統合したりすることは許可されません。 ⇒ https://support.google.com/analytics/answer/6366371 |

凡例

スコープ: インポート ディメンション値に関連付けるイベントを指定します。カスタム ディメンションには、次の 2 つのスコープのいずれかを指定できます。

- イベント: イベントに関する説明情報(例: イベント名)

- ユーザー: イベントをトリガーしたユーザーに関する説明情報(ポイント階層など)

スキーマキー: キーとなるディメンションや指標を指定します。キーは、このデータソース タイプにおいて、イベントに含まれる既存データとアップロードしたデータを紐付けるために使用されます。

インポートしたデータ: アナリティクスにアップロードしたデータで使用できるディメンションと指標です。

スキーマとして示しているディメンションと指標はあくまで参考用で、すべてが網羅されていない可能性があります。実際に使用できるディメンションと指標は、データソースの作成時に管理画面に表示されます。

テンプレート (クライアント ID)

User-ID データの CSV テンプレートは既に紹介しましたが、以下は、クライアント ID データのサンプルです。

client_id,stream_id,user_property1,user_property2,user_property3

1234567890.1234567890,1234567,user value 1,user value 1,user value 1

2345678901.2345678901,1234567,user value 2,user value 2,user value 2

3456789012.3456789012,1234567,user value 3,user value 3,user value 3端数が丸められてしまわないよう、クライアント ID は数値ではなく文字列として保存しましょう。

ストリーム IDの確認方法

管理 > プロパティ列 > データ ストリーム をクリックして、目的のデータ ストリームを開きます。

「ストリームの詳細」に「ストリーム ID」が表示されています。

オフライン イベントをインポートする

データソースの詳細

オフライン イベントデータについて

オフライン イベントは、インターネット接続が利用できない場合や、SDK または Measurement Protocol を経由したリアルタイムでのイベント収集がサポートされていない場合に、ソースからインポートできます。イベントをアップロードすると、関連するタイムスタンプ、またはタイムスタンプがない場合はアップロード時刻を使用して、SDK 経由で収集された場合と同様に処理されます。

自動的に収集されるイベント

( https://support.google.com/analytics/answer/9234069 )のほか、

業種ごとの推奨イベント( https://developers.google.com/analytics/devguides/collection/ga4/reference/events )、または正しい形式のカスタム イベント、パラメータ( https://developers.google.com/analytics/devguides/collection/ga4/tag-guide )、

ユーザー プロパティ( https://developers.google.com/analytics/devguides/collection/ga4/user-properties?technology=websites )

をインポートできます。

詳細( https://developers.google.com/analytics/devguides/collection/ga4/events )

このデータを削除するには、データ削除をリクエストするかユーザーを削除する必要があります( https://support.google.com/analytics/answer/9940393 )。

公式ヘルプ:https://support.google.com/analytics/answer/10325025?hl=ja&ref_topic=10054560

オフライン イベントデータのインポートの仕組み

オフライン イベントをインポートするには、アナリティクスのイベント スキーマに一致する CSV ファイルを作成します。後述のテンプレートの例をご覧ください。

カスタム ディメンションを作成する

アナリティクスにまだ存在していないディメンションの値をインポートして、そのデータをレポートに表示する場合、データをアップロードする前にそれらのディメンションを作成する必要があります。詳細( https://support.google.com/analytics/answer/10075209 )

(既に見たように、ユーザーデータのインポートの場合も、データをアップロードする前に、カスタム ディメンションを作成する必要があります。)

カスタム ディメンションの作成後、インポートするデータを認識できるようになるまでには、最大で 4 時間ほどかかります(カスタム ディメンションが処理されていることを確認するには、データ探索を開き、ディメンション選択ツールでディメンションが表示されるかどうかを確認します)。

データをアップロードする

アップロードの一般的な手順については、前出の「データ インポートについて」に記載されています。

データソースを作成する際は、「オフライン イベントデータ」を選択します。

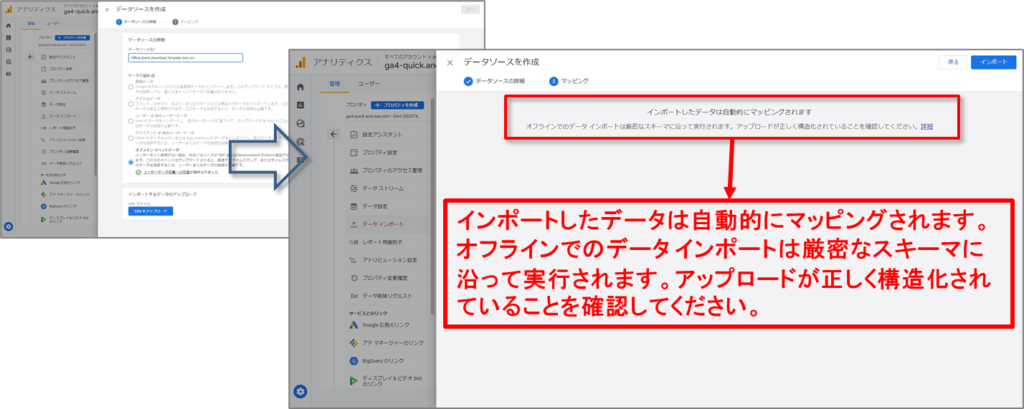

オフライン イベントでは、インポートしたフィールドがアナリティクス フィールドに自動的にマッピングされます。

データをアップロードしてから、レポート、オーディエンス、データ探索でそのデータを使用できるようになるまでには、最大 24 時間ほどかかります。

データを上書きするには、新しいデータをアップロードします。たとえば、同じイベント(例: measurement_id、client_id、timestamp_micros、event_name)に新しいパラメータ値をアップロードすると、古い値は新しい値で上書きされます。

(以下、「費用データ」「アイテムデータ」「ユーザーデータ」「オフライン イベントデータ」共通)

データ アップロード サービスからデータソースを削除しても、アップロードされたデータは削除されません。データ インポートでアップロードしたデータを完全に削除するには、他の収集手法の場合と同様に、データ削除が必要となることもあります。

アップロードの一般的な手順については、前出データ インポートについてに記載されています。

データソースを作成する際は、「オフライン イベントデータ」を選択します。

オフライン イベントでは、インポートしたフィールドがアナリティクス フィールドに自動的にマッピングされます。手動でマッピングを行う必要はありません。

データソースの詳細 凡例

| 範囲 | イベント |

| 必須項目 | •client_id または app_instance_id [いずれか 1 つ] •measurement_id または firebase_app_id [いずれか 1 つ] •(measurement_id と client_id)または(firebase_app_id と app_instance_id) •event_name measurement_idは、「測定 ID」のことを指します。 管理 > プロパティ列 > データストリーム > ウェブ >ウェブ ストリームの詳細 で、見ることがきます。 |

| インポートしたデータ | イベント、パラメータ、商品、ユーザー プロパティのデータは、次のヘッダー形式でアップロードできます。 •timestamp_micros(省略可。イベントから 72 時間以内で指定可能で、タイムスタンプがない場合はアップロードの時刻を使用する) •user_id(省略可。ただし、使用可能であれば推奨される) •event_param.<xxxxx>(任意の名前の任意のパラメータをインポートする) •user_property.<yyyyy>(任意の名前のユーザー プロパティをインポートする) •item<x>.<item_param>(例: item2.item_name) |

| メモ | オフライン イベントのインポートで、個人情報をアップロードしたり統合したりすることは許可されません。( https://support.google.com/analytics/answer/6366371 ) |

こちらは、シンプルなテンプレートです。

measurement_id,client_id,event_name,event_param.offline_event_param1,event_param.offline_event_param2

G-NMGXZVVKQW,10000000000,offline_event,param01,param02

G-NMGXZVVKQW,10000000000,offline_event,param01,param02

G-NMGXZVVKQW,10000000000,offline_event,param01,param02

G-NMGXZVVKQW,10000000000,offline_event,param01,param02上限など

予約済みの名前( https://developers.google.com/analytics/devguides/collection/protocol/ga4/reference?hl=ja#reserved_names )を使用したイベント、パラメータ、ユーザー プロパティは承認されません。

値のないアイテムのイベント パラメータ(item_list_name など)は拒否されます。アイテムのイベント パラメータは、推奨イベントのサブセット( https://support.google.com/analytics/answer/9267735 )(例: e コマース、求人、旅行)でサポートされています。

イベント名とパラメータ名は、次のルールに従う必要があります。

- イベントに指定できるパラメータの数は 25 個までです。

- イベントに指定できるユーザー プロパティの数は 25 個までです。

- ユーザー プロパティ名は 24 文字以下で指定する必要があります。

- ユーザー プロパティ値は 36 文字以下で指定する必要があります。

- イベント名は 40 文字以下で指定し、英数字とアンダースコアのみを含め、先頭を英字にする必要があります。

- パラメータ名(アイテム パラメータを含む)は 40 文字以下で指定し、英数字とアンダースコアのみを含め、先頭を英字にする必要があります。

- パラメータ値(アイテム パラメータ値を含む)は 100 文字以下で指定する必要があります。

こちらは、オフラインの売上データのテンプレートです

measurement_id,client_id,event_name,event_param.transaction_id,event_param.value,event_param.currency,item1.item_id,item1.item_name,item1.item_category,item1.item_category2,item1.item_category3,item1.item_brand,item1.item_variant,item1.quantity,item1.price

G-NMGXZVVKQW,10000000000,purchase,220001,10000,JPY,1,サブスク1,サブスク月額,music,jazz,green_note,HD,1,10000

G-NMGXZVVKQW,10000000001,purchase,220002,10000,JPY,2,サブスク2,サブスク月額,music,jazz,green_note,HD,1,10000

G-NMGXZVVKQW,10000000002,purchase,220003,10000,JPY,3,サブスク3,サブスク月額,music,jazz,green_note,HD,1,10000

G-NMGXZVVKQW,10000000003,purchase,220004,10000,JPY,4,サブスク4,サブスク月額,music,jazz,green_note,HD,1,10000上記のサンプルは、下記のフィールドに従って作成しています。

| フィールド名 | 説明 |

| measurement_id | 測定 ID 管理 > プロパティ列 > データストリーム > ウェブ >ウェブ ストリームの詳細 で、見ることがきます。 |

| client_id | client_idまたはapp_instance_id |

| event_name | 購入完了は「purchase」固定 |

| event_param.transaction_id | 取引を一意に識別する ID |

| event_param.value | 売上金額 |

| event_param.currency | 通貨(日本円はJPY:3文字の ISO 4217 形式) |

| item<x>.item_id | 商品ごとの固有ID |

| item<x>.item_name | 商品名 |

| item<x>.item_category | 商品カテゴリ カテゴリに階層がある場合はitem_category2~item_category5を利用 例)item1.item_category2 |

| item1<<N>>.item_brand | 商品ブランド名 |

| item<x>.item_variant | 商品のバリエーション(カラーやサイズなど) |

| item<x>.quantity | 商品の数量 |

| item<x>.price | 商品の金額 |

itemの解説

item<x>:商品ごとにインデックスを付与して設定します。

例)

item1.id

item1.item_name

item1.price

item2.id

item2.item_name

item2.price

コメント